深度学习之所以能超越传统的机器学习算法,关键原因在于它运用了神经网络技术。这项技术的核心要素涵盖了向量、矩阵等基本的数据结构。在接下来的环节,我们将对这些核心要素进行深入的探究和交流。

标量简介

x = 1标量是一个单独的数值,它有两种表现形式:一种是整数,另一种是实数。与线性代数中其他的研究对象不同,后者通常是由多个数值组成的数组。在众多数学和物理问题中,标量可以用来直接表达单一的数据信息,例如,一个物体的质量就可以通过标量来直接反映。

标量在众多应用场合中普遍存在。比如,在测量体温时,体温计上显示的数字就是标量的一个典型例子。这个数字仅用一个单一的数字来表示温度这一物理特性。在众多领域的数据记录与分析过程中,标量扮演着基础而至关重要的角色。

向量是什么

import numpy as np

#行向量

a = np.array([1,2,3,4])向量是由一串依次排列的数字组成的,我们可以根据它们的排列顺序来识别出每一个单独的数字。一般情况下,向量会用加粗的、小写字母来表示。以描述物体速度为例,我们不仅需要知道速度的具体数值,还必须了解它的运动方向,而向量恰好能够满足这一需求。

向量中的每一个组成部分都是一个标量数值。在坐标系统中,一个二维向量可以通过平面上的箭头来展示,这个箭头的长度和指向分别对应着向量的大小和方向。在计算机图形领域,向量被广泛用于描述物体的运动路径和朝向等关键信息,其处理方式既简单又高效。

import numpy as np

#矩阵

a = np.array([[1,2,3],[4,5,6],[7,8,9]])张量概念

张量,本质上是一种多维数组,其元素按照既定规则分布在多个维度的坐标网格上。我们将其称为张量。以三维张量为例,若想精确找到其中的一个元素,就必须使用三个索引值来定位。

张量一般用粗体的大写字母来表示。在深度学习领域,图像数据通常是以张量的形式来保存的。根据维度的不同,张量可以展示图像中的不同信息。以彩色图像为例,它可以通过一个三维张量来详尽地描述,而这个张量的三个维度分别代表了红、绿、蓝三种颜色通道。

import numpy as np

#张量

a = np.array([[[1,2],[3,4]],[[5,6],[7,8]]])点积运算

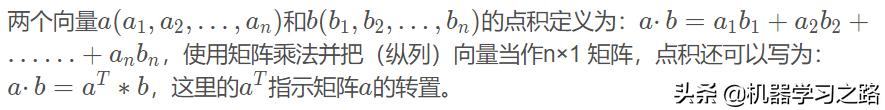

点积,亦称作数量积或内积,是一种数学运算方法。它接受实数域R中的两个向量作为输入,运算完成后,会输出一个实数值的标量。简而言之,这种运算涉及从第一个向量中挑选出在第二个向量方向上的部分,并对其进行相应的“标准化”处理。

点积运算遵守交换原则,因此向量顺序的改变不会对运算结果造成影响。在物理学领域,点积主要用于计算功。当力和位移均以向量形式存在时,它们的点积即表示力所完成的功。这一特性在处理众多实际问题中扮演了极为关键的角色。

矩阵乘法

import numpy as np

a = np.array([1,2,3])

b = np.array([3,2,1])

#向量的点积运算

print(np.dot(a,b))#10矩阵乘法是一项基础运算,这项运算有特定的要求,即参与运算的两个矩阵,第一个矩阵的列数必须与第二个矩阵的行数相匹配。举个例子,一个矩阵有m行p列,另一个矩阵有p行n列,它们相乘的结果将是一个新的矩阵,这个新矩阵将有m行和n列。

使用numpy库,我们能够进行矩阵的相乘操作。在众多实际应用中,特别是在经济学这一领域,我们经常采用矩阵乘法来计算不同产品在各个市场的总体销售额。这种做法极大地提高了处理大量数据的速度。

哈达马积规则

哈达马积,又称矩阵元素相乘,这种运算主要涉及对两个矩阵中相对应的元素执行乘法。执行此运算时,需确保两个矩阵的行数和列数相等。在Python编程语言中,计算这种乘积非常简单,只需对矩阵中的元素进行乘法操作即可。

若两个矩阵的行数与列数不一致,系统将显示错误信息。若其中一个矩阵为标量或向量,系统会自动执行广播运算,标量将与矩阵中的每个元素相乘,这相当于对矩阵元素进行了放大。在图像处理领域,此类操作可以通过哈达马积来调整图像的像素亮度。

在使用这些计算方法的过程中,你有没有遇到过一些难以解决的困难?不妨在评论区分享一下你的遭遇,同时,别忘了给我们点个赞,并把这篇文章转发出去!

import numpy as np

a = np.array([0,2])

b = np.array([3,3])

#向量的外积

c = np.cross(b,a)

print(c)