如今,深度学习在科技领域中逐渐崭露头角,成为举足轻重的核心力量。敬请关注今日深度探讨话题,揭示多层人工神经网络的内在奥秘。

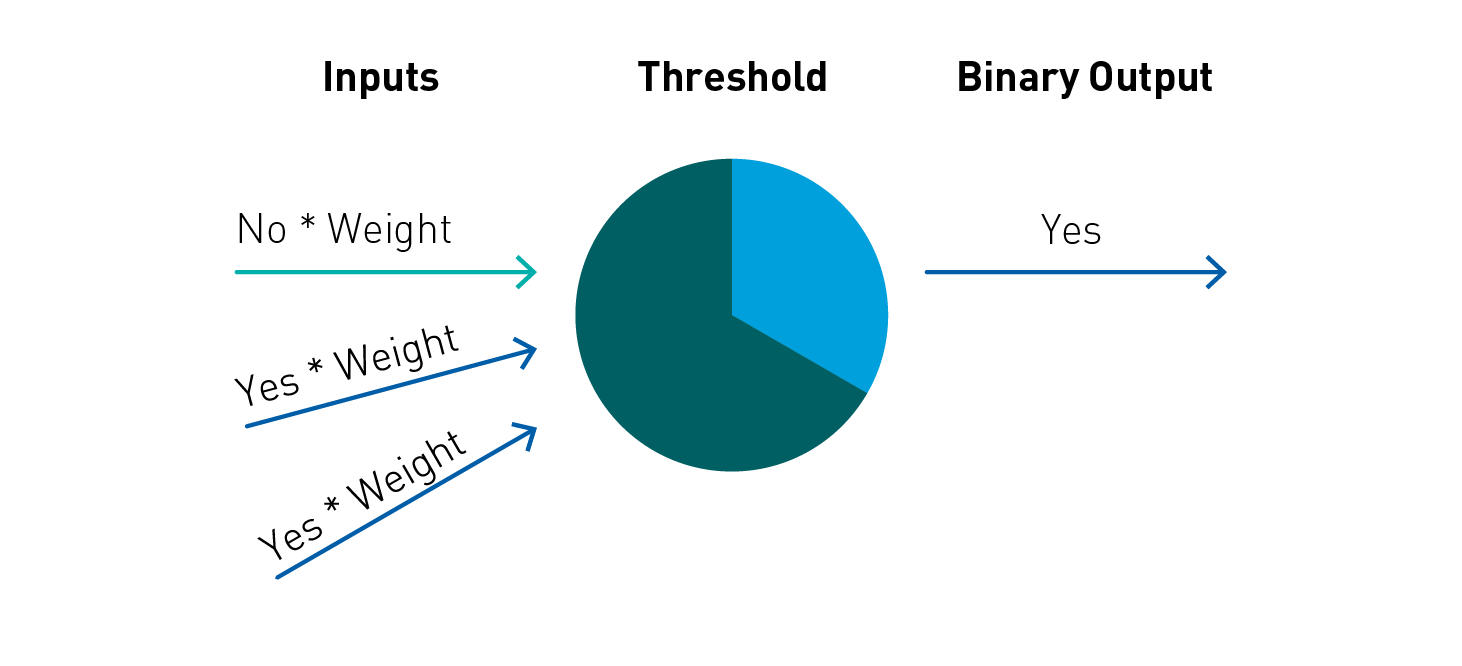

神经网络的基本构造

本模型是人工神经网络的整体结构,主要由诸多节点与连接构成复杂体系。隐含层在此处扮演着重要角色,它们将输入及输出以密不可分的方式联系在一起,使每一层都能作为通往更高层次认知的桥梁或转化器。而在转化器节点中的每个神经元,都通过其独特的非线性演算处理输入数值的权重总和,犹如人类大脑中悟道的信使。

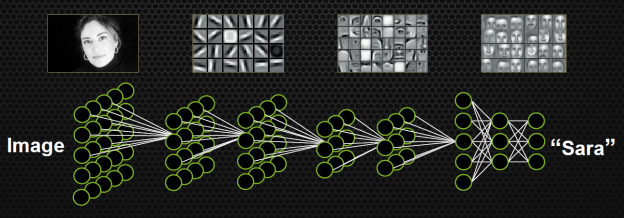

特征的学习与转换

借助计算机网络以各级产出作为特殊参数进行逐步式、以输入为主导的迭代学习过程,准确地解析并抽取图像中的非线性特性如复杂边缘及形状。经过最低层次的数据融合处理,我们能够量化预测结果,如同在迷雾笼罩的复杂迷宫中探索前行,每一次尝试都孕育着艰难的挑战和成功的喜悦。

梯度下降与反向传播

然而,令深度神经网络真正习得自我优化之能力的关键步骤在于梯度下降法。在这一过程中,误差逐层反向传导,如同水流回环,通过不断修正与优化权重,以提升模型性能。该过程需历经成千上万次反复,直至微小误差无法消除,宛若一场永无止境的修行,每次迭代都象征着向至臻完美的坚定步伐。

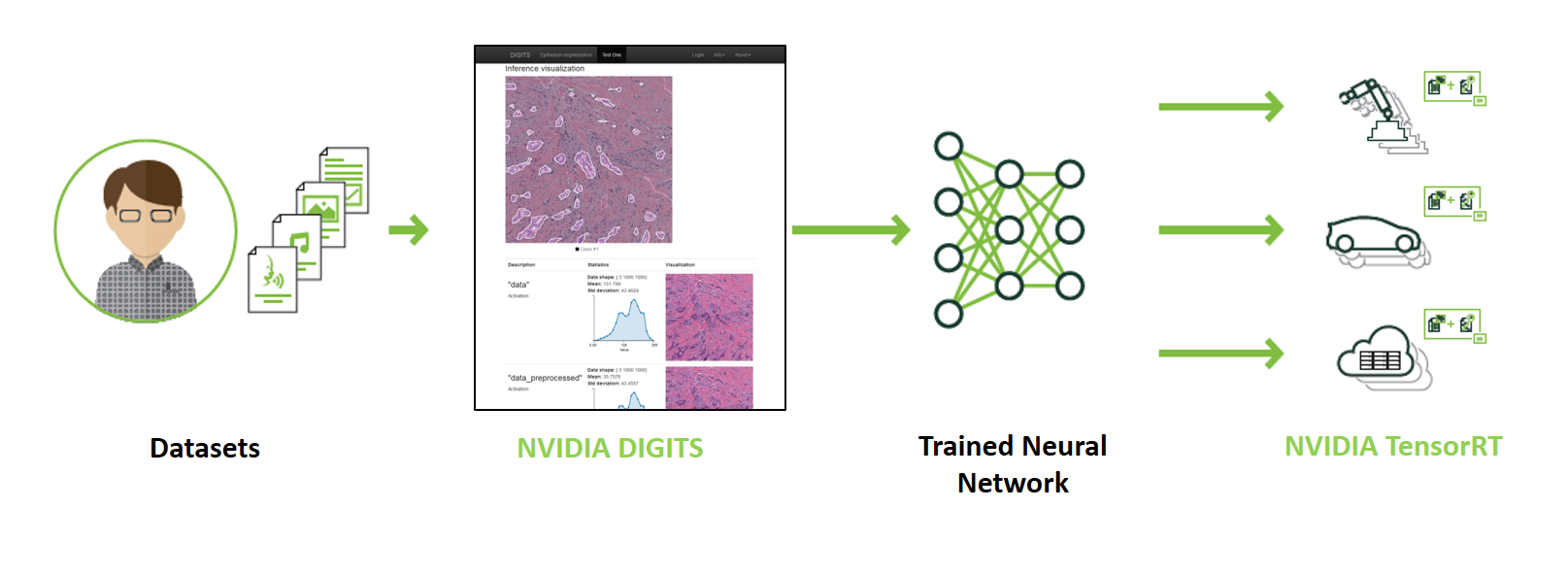

训练:神经网络的成长之路

研究界普遍称之为”训练”的环节,是通过运用人工神经网络处理大量数据以获取新知识。在此过程中,各个等级神经元自发性地掌握优化特征的技巧,无需人为设定特征。如此赋予了网络生命力,使之能够自我发现和适应现实中的各种复杂环境。

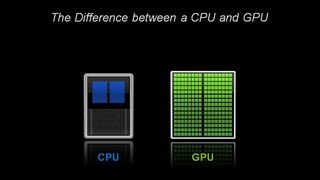

GPU:深度学习的加速器

因此,GPU(图形处理器)以其出色表现,成功取代传统CPU作为优化大规模神经网络系统的优先选择,因它拥有上百核且能并发执行数千项任务的巨大功效,堪称神经网络并行和高度并行性的理想搭档,极大提高了算力效果。仿佛一场长跑竞赛中的加速度器,助力我们更迅速地抵达胜利的彼岸。

推理运算的并行性

此算法并行特性使其更适配GPU设备,宛如为您配备了解密能手,助您迅速揭示谜底,提高思考效率。

神经网络的广泛应用

深度学习技术已深入应用至如自动驾驶、智能语音助手及医疗诊断等领域,乃至金融分析,其效能犹如魔法师般强大,助推我们解决众多难题,提高生活便捷度。

未来的展望

展望未来,神经网络与深度学习具有极大的发展潜能。在当今飞速发展的科技舞台上,众多卓越的创新应用层出不穷,每一次探索都为我们揭示了无尽的惊喜与期待,宛如对未知宇宙的探索。

无数专家与工程师倾力奉献,铸就了丰硕成果的基石。他们是勇敢的探知者,涉足种种未知领域,逐渐揭示生活中深藏的奥秘。